AIによる情報の画一化:私たちの選択肢は減るのか?情報の偏りを見る

今回は、クリエイティブ分野でのAIの活用がより進んだ未来を考察していきます。

- 情報の偏りとは何なのか?

- 回答は画一化していくのか?

に論点を置きます。

※この記事は、特定のAIやサービスを批判する目的ではありません。

AIの情報の偏り

AIの参照元

まず、AIにどんな情報を元にしているか聞いてみました。

あなたは、どの情報を参照して回答していますか?

ー回答ー

書籍、学術論文、ウェブサイト、ニュース記事、ブログ、フォーラムなど、

幅広い分野から収集されたテキストデータを指します。

この参照は、回答をより正解に導いているでしょう。

ここから見える情報の偏り

上記のような情報リソースには既に偏りが見えます。

例えば成功例を多く学習し、失敗を少なく学習しているのでは?

「ある企業をこんなことを行い、業績を上げた」こういったニュースは、多く取り上げられるでしょう。

「ある企業は、これで失敗した」というニュースは、少なくなり情報リソースは少なくなります。

この傾向から成功例に強いAIとして学習、また回答を行います。

一見、良いように思えますが、成功例を模倣することで成功するのでしょうか?

少数意見を出してくれないのは、問題ではないでしょうか?

↓少数意見まで持っていく検証記事です

感情的な部分の偏り

残らない情報

ビジネス分野だけでなく、感覚的な情報にも偏りが生じる可能性があります。

書籍、Web等の「記録された情報」を学習していますが、

「記録に残らない情報」は学習できません。

隠れた名店は、さらに隠れる?

例えば、地元の人に親しまれる居酒屋が食べログに載ったとします。

たまたま行った1人が低い評価を付けます。

すると、AIは新たな情報がない限り美味しくないお店と判断し、

それを私たちに回答します。

せっかく美味しいお店でも、口頭などの残らない情報では

美味しいお店としては提案してくれません。

するとさらに知られない店とされてしまいます。

これが起こり得る情報の偏りの危険性です。

情報の画一化の危険

これは、AIを用いた成果物をAIがまた学習することによって起こると考えています。

似た指示には、似た回答が出される

まず、同じ指示を与えた場合、似通った回答をします。

同じ指示を別チャットで行ってみた記事は、こちらです。

同じ簡潔なプロンプトでは

同じようなプラン、同じような画像、同じようなサイトを作ります。

それを良しとして使用した際にそれを正解と学習し続けるため

より似通った回答しか出さなくなるのでは?ということです。

クリエイティブの幅は極端に狭くなってしまうかもしれません。

また、情報の画一化の危険があるのではないか。

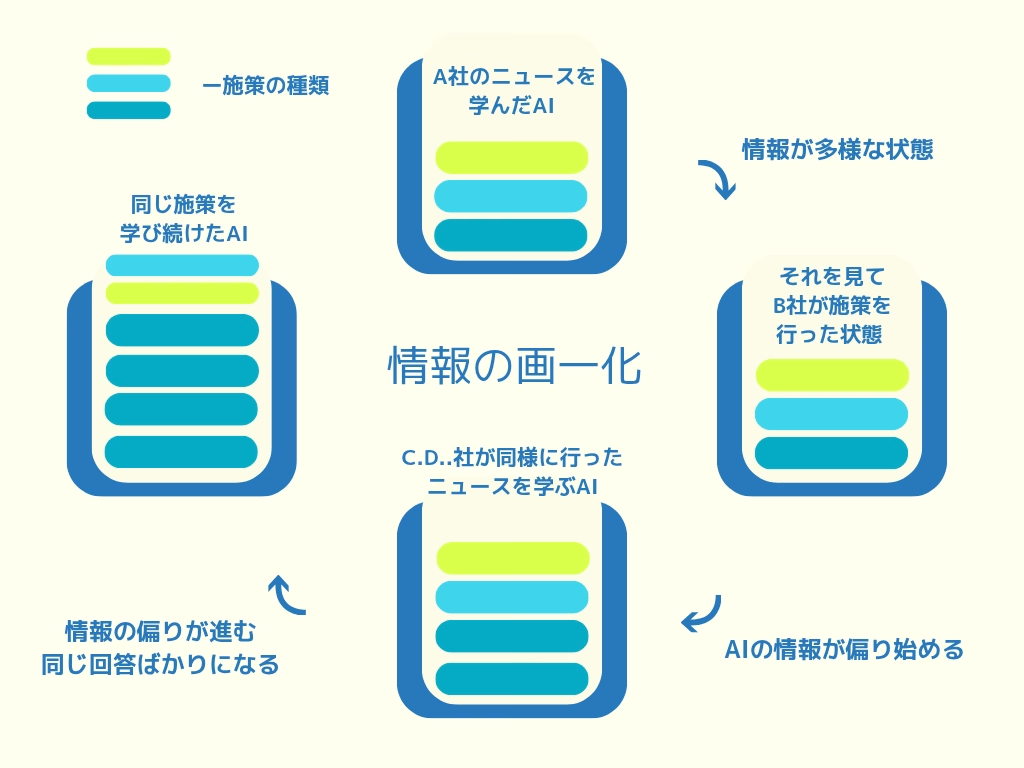

回答の画一化の例

A社が成功したニュースが出され、それを学習したAI

→そのAIの回答を用いたB社の成功した施策が情報として出される

それをAIがまた学習し、さらにそれを正解だと提示する→C社がその施策を行う。

こうなった場合、1つのニュースであった成功事例の学習は、

いつの間にか大きなニュースとなり、成功事例をAIに聞いた時に

提案されやすくなるはずです。

そのサイクルが起こることで、回答が収束していくのではないでしょうか?

- 他社と同じ施策

- 毎回同じような施策

は、上手くいくのでしょうか?

これを理由にクリエイティブAIが同じものしか作らなくなり、使い物にならなくなるのでは?

選択の危険が起こる未来

AIの厄介な点は、おおよそ正解に近そうという点です。

もしあなたが美味しいと薦められたイタリアン。

食べた時にすぐに美味しいと思いやすいのではないでしょうか?

ここは好みじゃないかもと思うことは少ないのでは?

AIの回答も正解らしいので、それに対しての反論等は欠如しがちなるのではないか?

と考えられます。

AIの活用に必要なのは、「NO」「もっと」という意識を持つことです。